高性能智算广域网络演进趋势及关键技术

人工智能应用正加速从单一大模型向智能体(AI Agent)体系演进,AI发展正式迈入“智能体元年”。与传统响应式AI工具不同,AI Agent具备持续交互、状态记忆、环境感知与自主决策等类人能力,正推动人机交互范式从“功能连接”向“持续服务连接”深刻转型。据IDC预测,到2030年,全球AI Agent数量将快速攀升至22.16亿,成为连接用户、服务与物理世界的数字基础设施,重塑终端形态、服务模式与产业生态格局。

在此背景下,AI流量特征发生根本性转变,AI Agent的7×24小时在线特性催生“低基线稳态、间歇性突发、弹性峰值”的新型流量模型。测算表明,AI驱动的网络流量年复合增长率高达51%,预计至2033年,整体流量规模将增长5至9倍。其中,东西向流量占比显著提升,逐步超越传统南北向流量,成为广域网络承载的核心挑战。

与此同时,AI算力集群正从万卡级向十万卡、百万卡规模快速演进。超大规模并行训练、云边端协同推理等新模式对网络提出前所未有的综合性能要求。传统“尽力而为”的网络架构已难以支撑AI业务对高吞吐、低时延、低抖动与高可靠性的承载需求。

面向未来,广域网亟需从“通用连接管道”向“算力使能网络”转型,为AI发展提供关键支撑。

智算业务场景和网络承载需求分析

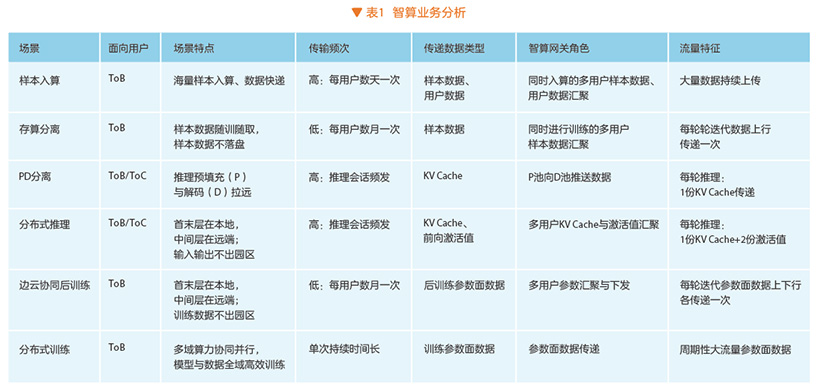

智算业务的多样化催生了高度异构的流量图谱。智算业务典型场景涵盖样本入算、存算分离、PD分离、分布式推理、边云协同后训练及分布式训练六大类型,这些场景在数据规模、传输频率、时延敏感度和突发性等方面差异显著,并呈现“规模跨度大、时延敏感度高、周期性与突发性并存”的共性特征(见表1)。

其中,PD分离与分布式推理中频繁传输的KV Cache具有小包高频、时延敏感的特点,要求网络具备微秒级响应与低抖动保障;而分布式训练的参数同步则需持续、无损、高吞吐的TB级数据传输;样本入算涉及PB级冷数据广域迁移,强调带宽利用率与时效性;存算分离场景单次数据量大,对网络带宽和传输稳定性要求高。

面对差异化、高动态的业务需求,网络亟需向“业务感知、按需切片、弹性适配”的智能体系演进:基于“网业分离”设计理念,构建面向多业务场景的统一承载平台;通过为不同业务类型设置独立的业务锚点,实现各业务平面的灵活独立演进与按需调优,既保障关键任务的服务质量,又有效隔离业务间相互影响,显著提升网络的可维护性与扩展性。

此外,端到端无损是关键场景的保障基石。RDMA对丢包极为敏感,即使2%的丢包也可能导致吞吐量断崖式下降。因此,在万卡级训练、实时推理等高同步强度任务中,必须构建跨广域无损能力,涵盖显式拥塞控制、动态速率调节与微突发缓冲机制,确保算力高效协同、零空转。同时,部分非实时场景如样本上传、参数异步更新等对时延与丢包容忍度较高,可引入智能有损机制,在保障整体服务质量及控制成本前提下提升带宽复用效率,形成分级承载策略。

综上,高性能智算广域网需构建“任务驱动、差异服务、端网协同”的新型架构,在统一承载基础上支持灵活演进,推动网络从“算网融合”向“网智共生共融”持续演进。

高性能智算广域网架构及关键技术

高性能智算广域网需支撑多样异构业务,通过端、网、管协同实现业务感知与资源动态匹配,构建弹性、无损、智能的承载体系,为智算任务提供可保障的传输服务。

端网协同架构

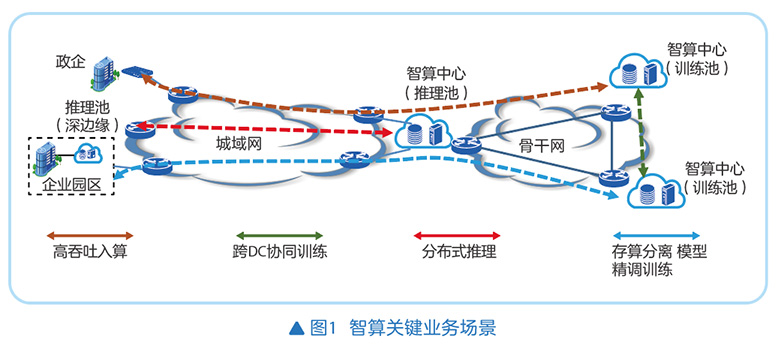

高性能智算广域网通过和端侧、算侧深度融合,进一步提升端到端整体性能。如图1所示,高性能智算广域网整体架构主要由端、网、管三类核心元素构成:

端侧,主要指智算网关,端侧作为数据传输的发起端,需具备动态速率调节能力,通过端网协同机制,端侧可接收网侧传输建议信息,优化传输速率,实现与网络状态的动态匹配。

网侧,包含广域网PE设备和转发设备,在保障公平性的情况下提供尽可能高的吞吐。通过与端侧的协同,网络能够感知业务流量特征,实施主动拥塞避免,提升传输效率与稳定性。

管控,主要由网络控制器和统一调度平台组成,负责广域网络流量控制和资源调度。通过与端侧、网侧的协同,控制器可基于传输任务特性和网络资源状况,动态分配带宽等资源,优化多任务并发下的资源利用率,提升整体网络效能。

端侧系统通常部署于智算中心或数据站点,端侧与网络通过端网协同进行拥塞控制,交互智算任务的流量需求及网络能力,协商传输速率。网络据此可提供资源规划及调度支持,保障各类任务的传输需求及资源承诺。

其中广域网可通过确定性无损技术提供高保障服务,网络预留带宽队列及buffer等资源并实施入口准入控制等手段,实现网络无拥塞、无丢包及可承诺时延。对于非关键或容忍丢包的业务,网络也可以通过智能QoS和智能ECMP等技术提供弹性承载:智能QoS可优化流量突发导致的丢包,实现吞吐最大化与最低时延的目标;智能ECMP则通过感知流量的生命周期及流量大小分布等动态特性,突破传统静态Hash机制的限制,实现多路径更均衡的负载分担。

端网协同关键技术

端网协同关键技术聚焦提升传输效率与网络利用率,通过拥塞控制、智能调度与路径优化等手段,实现流量与网络资源的动态适配,保障多场景下高性能传输需求。

- 智算网关与网PE协同的拥塞控制技术

智算场景中,突发流量在广域网传输时可能引发瞬时拥塞、丢包和排队延迟。传统拥塞控制机制下,端侧缺乏对网络的带宽资源的量化感知,导致速率调整不平滑,收敛速度慢,进而影响吞吐。为此,高性能智算广域网引入端网协同拥塞控制机制,基于任务级应用需求与端侧协商发送速率,通过向端侧动态分配和授权流量发送配额,预防网络拥塞,同时实现基于配额的资源调度、准入控制和流量调控,满足最优完成时间目标。通过端网协同,客户端和服务端可更精细、高效地调节发送速率。网络由此增强对流量的调控和资源调度能力,保障各类任务的传输需求及资源供给,提供可预测的网络行为,有效缓解网络拥塞。

- 智能大象流识别和报文级喷洒(packet spraying)技术

智算场景中,大流量传输常因广域网资源不足或分配不均导致链路利用率下降;多流并发传输海量数据时,易引发网络资源过载,造成拥塞和吞吐下降。为提升带宽利用率,需实现多路径负载平衡,以达成低延迟、零丢包和高吞吐量的传输性能。传统静态ECMP负载均衡的核心问题在于固定哈希策略无法适应动态流量特征,易导致流量分配不均(如大象流独占路径)、协议层冲突(如TCP报文乱序),在AI训练等高并发、高突发性场景下问题尤为突出。

为此,高性能智算广域网引入报文级喷洒技术,将同一个AI训练任务的数据流切分为细粒度报文,并均匀调度到网络所有可用路径上,充分复用多路径带宽资源,显著提升整体带宽利用率。

线卡集成AI-flow分析组件,实时识别大象流并监控其生命周期及带宽等基线统计信息:

- 流量带宽度量:基于端口负载、流带宽、队列深度等因子,识别潜在拥塞风险,为路径选择提供依据;

- 生命周期度量:监测流的生命周期与实时统计数据,动态选择进入或者离开策略。

基于AI-flow的流量基线信息,系统综合评估流的传输特征与各ECMP路径的负载状态,动态计算最优路径。通过多路径流量智能调度,实现带宽聚合、毫秒级故障切换,有效突破传统静态哈希机制的性能瓶颈。

标准进展

为应对智算场景对低时延、高吞吐、低丢包的严苛需求,互联网工程任务组(IETF)已在传输、管控与路由等多个技术领域启动相关标准研究与讨论。在传输层面,SCONE、TSVWG、CCWG等工作组聚焦于RDMA(包括RoCE)与TCP、QUIC等协议的适配机制,并深入研究CUBIC、BBR等拥塞控制算法的优化方案。同时,IETF正在推进“高性能广域网”(HP-WAN)新课题的研究与讨论,明确广域网需支持高速、低延迟与超高容量的应用场景,满足高吞吐与低时延并重的基础能力需求。

国际电信联盟ITU SG13在算网架构、资源建模、业务增强方面提供了顶层设计和参考架构,为全球算网融合标准化进程奠定基础。国内以CCSA为核心,已启动《面向智算业务的广域网总体技术要求》等行业标准立项和制定工作,围绕广域无损、应用感知、确定性承载等关键方向初步形成体系化布局。

构建面向AI未来的智算广域网络新格局

中兴通讯认为,人工智能已进入新一轮高速发展周期,尽管传统规模定律(Scaling Law)的边际效益正面临挑战,但业界对算力规模的需求仍在持续增长,驱动重心正从大规模预训练向后训练、推理及多智能体协同等多元化场景延伸。在此背景下,AI集群规模从万卡向十万卡乃至百万卡演进,已成为行业发展的关键趋势。作为AI基础设施的核心组成部分,广域网络亟需同步升级,迎来新一轮技术革新。

在面向AI业务的广域承载网络的演进中,无损与有损技术并非优劣对立,而是面向不同业务需求、部署条件与规模边界形成的差异化技术路径。二者并非替代关系,而是长期共存、按需分层、智能适配,最终形成“关键任务无损保确定性、非关键流量有损保普惠性”的智算承载新格局。

当前多种技术路径并行发展,创新活跃,尚未形成统一标准,正处于关键技术路线的探索与收敛期。网络已成为驱动算力释放的关键使能者,唯有通过端网深度协同与技术架构持续创新,方能构建面向超大规模AI集群的高效、弹性、智能、确定性广域网络,为人工智能的下一阶段发展提供坚实支撑。

.png)

.png)