基于GSE技术的十万卡级组网:智算中心Scale-Out网络新路径

在人工智能技术浪潮的驱动下,智算数据中心迎来跨越式发展机遇。大模型训练与推理对算力的需求呈指数级激增,推动智算中心从小规模集群加速向超大规模集群演进,十万卡级GPU组网已成为行业竞争的核心基础设施壁垒。但海量GPU节点的高频数据交互使网络带宽需求同步激增,通信效率成为制约训练效率的关键瓶颈。

为破解当前网络架构中算力与网络的适配难题,中国移动联合产业伙伴自主创新研发出全调度以太网(Global Scheduling Ethernet,GSE)技术体系。该技术通过深度优化以太网架构,构建“主动调度+精准分发”的传输机制,为智算数据中心Scale-Out网络提供全新研究视角。

相比RoCE技术,GSE技术创新提出报文容器(packet container,PKTC)、全局动态调度队列(dynamic global scheduling queue,DGSQ)等概念。通过对报文容器的转发与逐容器喷洒,实现单流在多路径上的均匀分担,大幅提升带宽利用率;通过DGSQ搭建拥塞控制体系,引入授权请求与全局调度机制,确保流量负载不超过网络承载上限,从根源上规避拥塞丢包。采用GSE技术搭建十万卡级网络成为当下热点研究对象。GSE组网架构依据互联方式的差异可划分为三层组网架构和多PoD互联架构两类,采用层次化、模块化方式设计,适配不同应用场景需求。

三层组网架构

GSE三层组网架构采用搭载51.2T芯片的盒式交换机搭建,单台交换机可提供128个400GE端口,按无收敛方式设计。

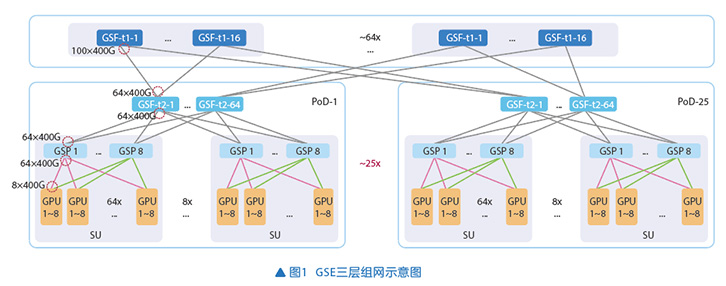

根据层次化思想,网络分为三层:接入层、转发层、互联层。如图1所示,接入层由GSP(global scheduling processor,全调度以太网处理节点)设备构成,用于将GPU服务器接入网络;转发层由GSF-T2(global scheduling fabric,全调度交换网络)设备构成,用于 PoD(point of delivery)内GSP之间的转发;互联层由GSF-T1设备构成,用于 PoD间的互通。

根据模块化设计,网络分为SU(scale unit,扩展单元)、 PoD、DC(data center,数据中心)等不同层级的模块。8轨部署中的8台GSP设备及其所连接的服务器共同构成一个SU模块;多组SU及其共同相连的GSF-T2设备组成一个 PoD单元;多个 PoD及其之间互联的GSF-T1设备组成一个DC网络。

组网部署

每台服务器搭配8张GPU卡,提供8个400GE端口,按需选择零轨部署或轨道化部署模式。GSP设备独立部署,其中64个400GE端口用于与服务器互联,剩余64个端口与64台GSF-T2设备互联。GSF-T2设备独立部署,其中64个400GE端口通过Full Mesh方式与GSP设备互联,另外64个端口与多平面部署的GSF-T1设备互联。GSP-T1设备独立部署,为提高组网规模,采用多平面设计架构。最大可分为64个平面,每个平面内部署16台GSF-T1设备,分别与其他 PoD中对应序号的GSF-T2设备互联。单个 PoD可提供4K卡规模部署,三层组网架构最大可接入128PoD,整网GPU卡容量最大可达512K。若需支撑10万卡规模部署,仅需配置25个PoD单元即可满足需求。

功能部署

GSP设备、GSF-T2设备、GSF-T1设备之间部署EBGP协议,通过BGP扩展属性将GSE所需的DPORT信息、GSPID信息同步发布至整个网络。

部署GSE N2N功能,GSP设备作为进入/退出GSE域的接入点,部署基于容器的转发策略、GSE头信息的封装与解封装、授权请求与响应处理及数据排序等功能;GSF设备作为GSE域内转发节点,部署GSE流量识别、基于GSE头信息的多路径转发等功能。

GSP设备与服务器相连的端口按需部署PFC(priority-based flow control,基于优先级的流量控制)功能,当源端口+优先级对应的缓存使用量到达阈值时,可向源服务器发起PFC反压,实现源端速率调控。

流量模型

同GSP设备下转发,源服务器网卡发送IP报文,经GSP设备,直接以IP报文形式转发至同一GSP设备下的目的服务器网卡。

同 PoD内服务器间转发,源服务器网卡发送IP报文,经源GSP设备封装GSE头信息,采用容器喷洒方式至GSF-T2设备,GSF-T2设备根据GSE头信息转发至目的GSP设备,目的GSP设备解封还原为IP报文,转发至目的服务器网卡。

跨 PoD转发,源服务器网卡发送IP报文,经源GSP设备封装GSE头信息,容器喷洒至GSF-T2设备,GSF-T2设备根据GSE头信息转发至GSP-T1设备,GSF-T1设备进一步转发至目标 PoD的GSP-T2设备,最终经目标 PoD的目的GSP设备解封还原成IP报文,转发至目的服务器网卡。

多PoD互联架构

GSE多PoD互联架构同样采用搭载51.2T芯片的盒式交换机搭建,单台交换机提供128个400GE端口,按无收敛方式、层次化、模块化设计。

组网部署

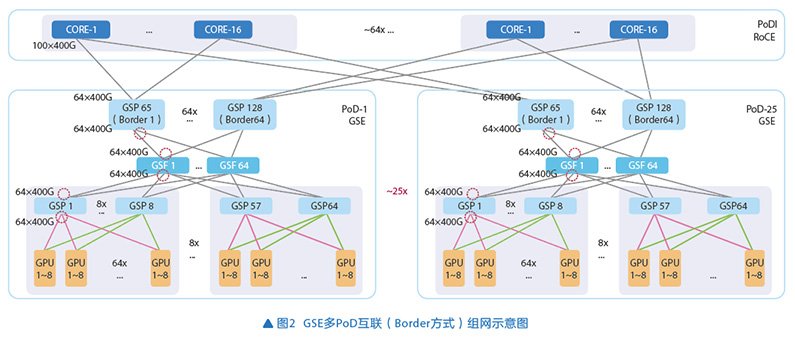

如图2所示,每台服务器搭配8张GPU卡,提供8个400GE端口。按需选择零轨部署或轨道化部署模式。GSP设备独立部署,其中64个400GE端口与服务器互联,剩余64个端口连接至64台GSF设备。GSF设备独立部署,其中64个400GE端口通过Full Mesh模式与GSP设备互联,另外64个端口与BORDER设备互联。BORDER设备独立部署,其中64个400GE端口采用Full Mesh方式与GSF设备互联, 剩余64个端口连接至用于PoD间互联的CORE设备。CORE设备独立部署,为扩大PoD间互联规模,采用多平面方式部署。共设置64个平面,每个平面内部署16台CORE设备,分别与其他PoD中对应序号的BORDER设备互联。单个PoD可提供4K卡(400G带宽/GPU)规模部署,最大可实现128个PoD互联,整网GPU卡容量最大可达512K。支撑10万卡规模部署时,需配置25个PoD单元。

功能部署

PoD内采用GSE N2N方式部署,PoD间采用IP RoCE方式部署。

对于PoD内,GSP设备、GSF设备、BORDER设备之间部署EBGP协议,通过BGP扩展属性发布GSE所需的DPORT信息、GSPID信息。部署GSE N2N功能,GSP设备和BORDER设备作为接入/退出GSE域的接入点,GSF设备作为GSE域内转发节点。GSP设备与服务器之间按需部署PFC功能,当拥塞时可以向源服务器网卡发起PFC反压,实现源端速率调控。

对于PoD间,BORDER设备与CORE设备之间部署动态路由协议(如EBGP协议),打通网络三层路由可达性。部署RoCE功能,配套部署PFC、ECN功能,为无损通信提供保障。

流量模型

同GSP设备下转发,源服务器网卡发送IP报文,经GSP设备,直接以IP报文转发给同一GSP下的目的服务器网卡。

同PoD内服务器间转发,源服务器网卡发送IP报文,经源GSP设备封装GSE头信息,容器喷洒至GSF设备,GSF设备根据GSE头信息转发至目的GSP设备,目的GSP设备解封还原成IP报文,转发至目的服务器网卡。

跨PoD转发,源服务器网卡发送IP报文,经源GSP设备封装GSE头信息,容器喷洒至GSF设备,GSF设备根据GSE头信息转发至BORDER设备,BORDER设备解封还原成IP报文并转发至CORE设备,CORE根据路由信息转发至目的PoD的BORDER设备,BORDER设备将IP报文重新封装为GSE报文,经目标PoD内GSF设备转发至目的GSP设备,目的GSP设备解封还原成IP报文,转发至目的服务器网卡。

其他组网架构优化

考虑到实际业务开展及部署实施的差异化需求,GSE网络的组网架构可从多个不同方向进行针对性优化。

- 收敛比配置:考虑到跨PoD流量通常小于PoD内流量,可按需针对性配置收敛比。其中,三层组网架构的收敛比部署在GSF-T2设备,多PoD互联架构的收敛比部署在BORDER设备。常规推荐收敛比为1:7。

- 单PoD规模最大:三层组网架构中,可在GSF-T2层采用轨道化部署。将原Full Mesh全互联方式,调整为不同SU单元中同序号的GSP设备与若干台GSF-T2设备互联,组成一个轨道;不同序号的GSP设备和其他GSF-T2设备互联,组成其他若干轨道。调整后单PoD最大可支持32K卡规模,且轨道化部署与Full Mesh部署构建十万卡级组网的设备及光模块总用量保持一致。

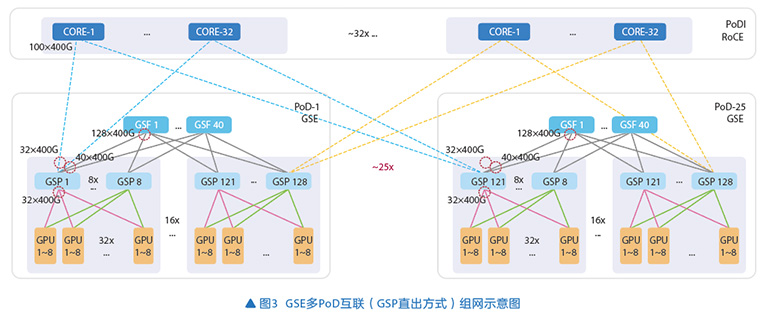

- PoD间跳数最少:多PoD互联架构中,为减少PoD间流量转发跳数,可将PoD内简化为GSP设备和GSF设备的两层组网,如图3所示,PoD间由GSP设备直接接至PoDI的CORE设备上,使跨PoD流量可直接接入PoDI网络,减少经过PoD内的跳数。该方式对于PoD内网络,可在GSP设备上到GSF方向部署加速比,提高网络吞吐;对于PoD间网络,可在GSP设备上到PoDI方向部署收敛比。

GSE技术为十万卡级智算组网提供了无阻塞、高均衡的核心技术支撑,能够有效解决传统组网技术痛点,推动智算集群向更大规模演进,并为构建新一代智算网络、赋能智算产业高质量升级提供有力保障。

.png)

.png)