高效推理加速AI落地

随着AI应用规模化进入生产环境,推理服务系统已成为支撑AI技术落地、实现价值转化的核心载体。当前AI应用落地过程中的场景多元化、需求精细化,对推理系统的安全性、调度效率、资源利用率及适配能力提出了新的要求。

- 需求一:构建推理系统全栈原生安全管控体系

AI应用除了依赖模型本身提供的基础安全合规能力外,还需要针对具体落地场景,面向文本、图像、音频、视频等多模态输入输出,从推理系统层面提供定制化、系统级、全链路安全防护机制,提供精准、实时、全覆盖违规内容识别与风险响应能力,满足AI应用落地的安全合规要求。

- 需求二:实现基于大模型推理特性的消息调度机制

在AI应用规模化落地、多类型大模型推理任务并发执行的背景下,现有调度机制难以适配LLM推理的计算特征与差异化业务诉求,易引发GPU资源空转或过载、KV Cache资源低效利用与供给不足等瓶颈。需构建适配大语言模型推理特性的消息调度机制,实现GPU算力、KV Cache等关键资源的高效分配与动态均衡。

- 需求三:支持推理任务流量路由机制

推理任务复杂度不同,对算力资源的需求也不同,如问候交互、短句翻译等快思考简单任务,与逻辑推理、代码生成等慢思考复杂任务对算力的需求差异较大。推理系统需要构建基于任务复杂度的流量路由机制,进行差异化路由;降低简单任务时延、减少算力浪费,保障复杂任务算力供给,匹配AI应用多样化落地需求。

- 需求四:更长的上下文推理能力增强

随着AI应用的落地深入,文档理解、知识库问答、代码分析、长对话记忆、复杂Agent规划等核心场景,需要更长的上下文长度(目前正在从K级向M级演进)推理能力支持,解决该场景下并发下降、显存溢出、时延陡增、系统稳定性下降等问题。

- 需求五:推进推理全栈优化与硬件算力极致释放

AI应用规模化落地要求在现有硬件资源条件下实现更高吞吐、更低时延、更大并发。需通过推理服务系统软件调度与硬件资源极致协同,压榨硬件性能,提升硬件资源利用率、降低单Token推理成本,解决算力释放不充分、整体投入成本偏高的问题。

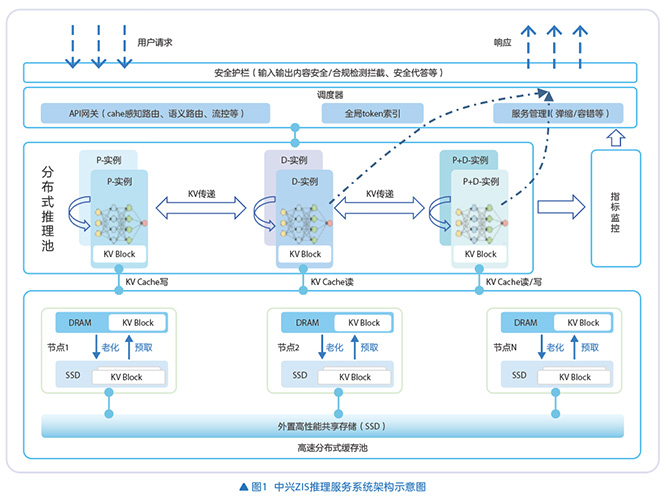

AI应用规模化落地带来的新需求,使得构建一套高性能极致软硬协同的低成本推理服务系统,成为AI应用走向规模化普及的必然选择。中兴通讯高效分布推理服务系统ZIS(ZTE Infer System),正是在这种挑战背景下设计推出的。中兴ZIS推理服务系统是一个集成了安全防护、智能调度、流量路由、长下文支持、极致软硬协同的低成本高效大模型推理平台(见图1)。

- 原生安全防护

推理服务系统内置安全护栏组件,基于安全合规领域微调的安全模型,或黑名单及敏感词列表,对用户在推理服务过程中的输入输出文本和多模态内容进行安全检测,构建安全防护基础防线。

- 智能消息调度

调度器针对大模型推理服务特点进行调度能力增强,支持GPU负载感知、KV Cache感知、最少消息负载、SLA指标感知的消息调度机制,为每个请求消息最佳匹配推理资源。

- 流量路由

基于语义路由技术,调度器前置一个轻量级路由模型,对用户业务请求进行语义复杂度分析。简单任务(如问候、翻译)路由至小参数模型(快思考、低成本低延时),复杂任务(如逻辑推理、代码生成)路由至大参数或思维链模型(慢思考、高质量),任务处理隔离,最优匹配算力资源。

- 更长下文推理能力增强

引入稀疏注意力、语义压缩及位置无关KV Cache复用等优化技术,优化更长上下文处理能力,支持100K+甚至1M+的超长上下文推理,并在保持精度的同时将计算复杂度控制在可接受范围内。

- 极致软硬协同

支持PD分离技术,将不同负载分配至最优匹配的硬件节点,实现“专卡专用”,充分释放硬件潜能。同时,配合KV Cache复用及KV Pool技术,跳过已命中Tokens的计算耗时,有效增加推理速度,实现极速响应。

2025年下半年,中兴ZIS推理服务系统联合国内运营商,基于国产化GPU卡和DeepSeek-R1 671B-Int8量化模型,进行了严格的实验室测试。测试结果表明:基于ZIS的推理服务系统,单卡吞吐量最大提升7.6倍左右。

中兴ZIS推理服务系统以最低的资源实现最大的Token吞吐量,发挥用户投资价值,已在使能AI应用中发挥显著成效。未来,随着多模态推理需求进一步提升与边缘端推理的普及,ZIS将进一步向边端云协同、更细粒度的动态优化方向演进,持续赋能千行百业的AI应用落地。

.png)

.png)